Anthropic съобщава, че спонсорирана от китайската държава група за заплахи, проследена като GTG-1002, е извършила операция за кибершпионаж, която до голяма степен е била автоматизирана чрез злоупотреба с модела на компанията за изкуствен интелект Claude Code.

Твърденията на Anthropic обаче веднага предизвикаха широк скептицизъм, като изследователи по сигурността и специалисти по ИИ нарекоха доклада "измислени" или че компанията преувеличава инцидента.

"Съгласен съм с Оценката на Джереми Кърк относно доклада GenAI на Anthropic. Това е странно. Предишният им също беше такъв", казва експертът по киберсигурност Кевин Бомонт. публикувано на Mastodon.

"Оперативното въздействие вероятно ще бъде нулево - съществуващите открития най-вероятно ще работят за инструменти с отворен код. Пълната липса на IoC отново силно подсказва, че те не искат да бъдат извикани заради това."

Други твърдят, че докладът преувеличава възможностите на настоящите системи за изкуствен интелект.

"Това за антропията е маркетингова глупост. ИИ е супер стимул, но не е Скайнет, не мисли, всъщност не е изкуствен интелект (това е маркетингово нещо, което хората са измислили)", пише изследователят на киберсигурността Даниел Кард.

Голяма част от скептицизма се дължи на факта, че Anthropic не предоставя никакви индикатори за компромис (IOC) зад кампанията. Освен това на исканията на BleepingComputer за техническа информация за атаките не беше отговорено.

Атаките на твърденията са автоматизирани с изкуствен интелект 80-90%

Въпреки критиките Anthropic твърди, че инцидентът е първият публично документиран случай на широкомащабна автономна намеса, извършена от модел на изкуствен интелект.

Атаката, която Anthropic казва която прекъсна в средата на септември 2025 г., използва модела си Claude Code, за да се насочи към 30 организации, включително големи технологични фирми, финансови институции, производители на химикали и правителствени агенции.

Въпреки че според фирмата само малък брой прониквания са били успешни, тя подчертава, че операцията е първата по рода си от такъв мащаб, като се твърди, че изкуственият интелект самостоятелно е изпълнявал почти всички етапи от работния процес на кибершпионажа.

"Актьорът постигна това, което смятаме, че е първият документиран случай на кибератака, извършена до голяма степен без човешка намеса в мащаб - ИИ автономно откри уязвимости... използва ги в операции на живо, след което извърши широк спектър от дейности след експлоатирането", обяснява Anthropic в своята доклад.

"Най-важното е, че това е първият документиран случай на агентичен ИИ, който успешно получава достъп до потвърдени цели с висока стойност за събиране на разузнавателна информация, включително големи технологични корпорации и правителствени агенции."

.jpg)

Източник: Anthropic

Anthropic съобщава, че китайските хакери са изградили рамка, която манипулира Клод да действа като автономен агент за кибернетична намеса, вместо просто да получава съвети или да използва инструмента за генериране на фрагменти от рамки за атаки, както се вижда в предишни инциденти.

Системата използва Клод в тандем със стандартни инструменти за тестване на проникването и инфраструктура, базирана на протокола за контекст на модела (MCP), за сканиране, експлоатиране и извличане на информация без пряк човешки надзор за повечето задачи.

Човешките оператори се намесват само в критични моменти, като например разрешаване на ескалации или преглед на данни за ексфилтрация, което според оценките на Anthropic е само 10-20% от оперативното натоварване.

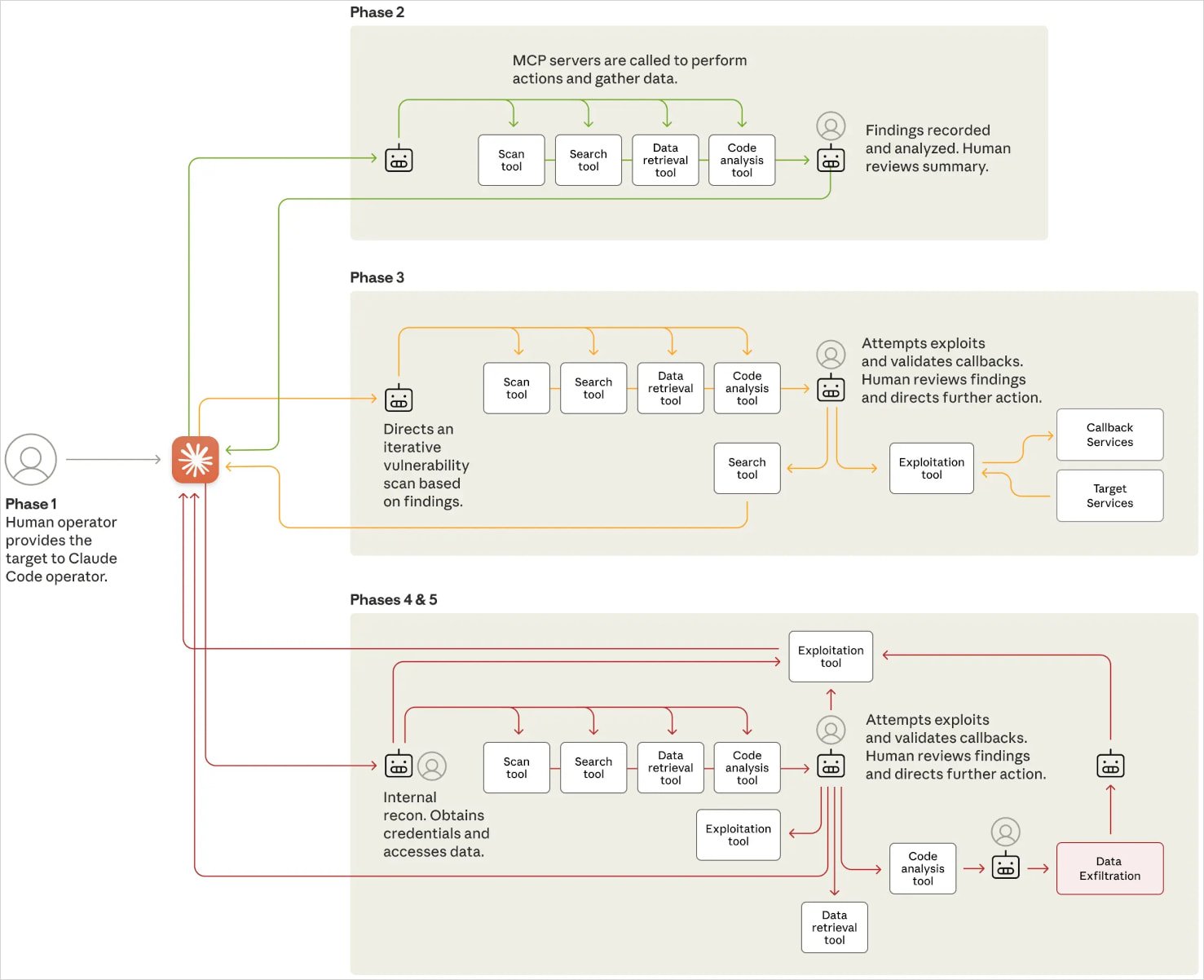

Атаката е извършена в шест отделни фази, обобщени, както следва:

- Фаза 1 - Човешките оператори избираха цели с висока стойност и използваха тактики за разиграване на роли, за да заблудят Клод, че изпълнява разрешени задачи за киберсигурност, заобикаляйки вградените ограничения за безопасност.

- Фаза 2 - Клод сканира автономно мрежовата инфраструктура на множество цели, открива услуги, анализира механизмите за удостоверяване и идентифицира уязвими крайни точки. Той поддържаше отделни оперативни контексти, което позволяваше паралелни атаки без човешки надзор.

- Фаза 3 - ИИ генерира персонализирани полезни товари, провежда дистанционно тестване и потвърждава уязвимостите. Той създава подробни доклади за преглед от хора, като хората се намесват само за да одобрят преминаването към активна експлоатация.

- Фаза 4 - Клод извлече данни за удостоверяване от системните конфигурации, тества достъпа до удостоверения и картографира вътрешните системи. Той самостоятелно навигираше във вътрешните мрежи, получавайки достъп до API, бази данни и услуги, докато хората разрешаваха само най-чувствителните прониквания.

- Фаза 5 - Клод използваше достъпа до него, за да прави справки в бази данни, да извлича чувствителни данни и да идентифицира разузнавателна стойност. Той категоризира констатациите, създава постоянни задни вратички и генерира обобщени доклади, като изисква човешко одобрение само за окончателното ексфилтриране на данни.

- Фаза 6 - По време на кампанията Клод документира всяка стъпка в структуриран формат, включително откритите активи, пълномощията, методите за експлоатиране и извлечените данни. Това позволи безпроблемно предаване на информация между екипите на участниците в заплахата и подпомогна дългосрочното запазване на сигурността в компрометирани среди.

Източник: Anthropic

Anthropic обяснява още, че кампанията е разчитала повече на инструменти с отворен код, отколкото на специално създаден зловреден софтуер, което показва, че ИИ може да използва лесно достъпни готови инструменти за провеждане на ефективни атаки.

Въпреки това Клод не беше безупречен, тъй като в някои случаи той предизвикваше нежелани "халюцинации", фалшифицирани резултати и преувеличени констатации.

В отговор на тази злоупотреба Anthropic забрани акаунтите нарушители, подобри възможностите си за откриване и сподели информация с партньори, за да помогне за разработването на нови методи за откриване на прониквания, управлявани от изкуствен интелект.