Anthropic riferisce che un gruppo di minacce sponsorizzato dallo Stato cinese, identificato con il nome di GTG-1002, ha condotto un'operazione di cyberspionaggio in gran parte automatizzata grazie all'abuso del modello AI Claude Code dell'azienda.

Tuttavia, le affermazioni di Anthropic hanno immediatamente scatenato un diffuso scetticismo, con ricercatori di sicurezza e professionisti dell'IA che hanno definito il rapporto "un'opera d'arte".inventato" o l'azienda di sopravvalutare l'incidente.

"Sono d'accordo con Valutazione di Jeremy Kirk del rapporto GenAI di Anthropic. È strano. Anche quello precedente lo era", ha dichiarato l'esperto di cybersicurezza Kevin Beaumont. pubblicato su Mastodon.

"L'impatto operativo dovrebbe essere nullo: i rilevamenti esistenti funzioneranno molto probabilmente per gli strumenti open source. La completa mancanza di IoC suggerisce ancora una volta che non vogliono essere chiamati in causa".

Altri hanno sostenuto che il rapporto esagera ciò che gli attuali sistemi di IA possono realisticamente realizzare.

"Questa storia dell'antropica è una sciocchezza del marketing. L'IA è una super spinta, ma non è Skynet, non pensa, non è in realtà intelligenza artificiale (è un'idea di marketing che si è inventata la gente)", ha scritto il ricercatore di cybersecurity Scheda Daniel.

Gran parte dello scetticismo deriva dal fatto che Anthropic non ha fornito alcun indicatore di compromissione (IOC) dietro la campagna. Inoltre, le richieste di BleepingComputer di informazioni tecniche sugli attacchi non hanno ricevuto risposta.

Gli attacchi alle richieste di risarcimento sono stati 80-90% AI-automatizzati

Nonostante le critiche, Anthropic sostiene che l'incidente rappresenta il primo caso pubblicamente documentato di attività di intrusione autonoma su larga scala condotta da un modello AI.

L'attacco, che Antropico dice che ha interrotto a metà settembre 2025, ha utilizzato il suo modello Claude Code per colpire 30 entità, tra cui grandi aziende tecnologiche, istituzioni finanziarie, produttori chimici e agenzie governative.

Sebbene l'azienda affermi che solo un piccolo numero di intrusioni è andato a buon fine, sottolinea che l'operazione è la prima del suo genere su questa scala, con l'IA che avrebbe condotto autonomamente quasi tutte le fasi del flusso di lavoro del cyberspionaggio.

"L'attore ha realizzato quello che riteniamo sia il primo caso documentato di cyberattacco eseguito in larga misura senza intervento umano su scala: l'IA ha scoperto autonomamente le vulnerabilità... le ha sfruttate in operazioni dal vivo, quindi ha eseguito un'ampia gamma di attività post-exploitation", spiega Anthropic nel suo documento. rapporto.

"L'aspetto più significativo è che si tratta del primo caso documentato di IA agenziale che è riuscita a ottenere l'accesso a obiettivi confermati di alto valore per la raccolta di informazioni, tra cui grandi aziende tecnologiche e agenzie governative".

.jpg)

Fonte: Antropico

Anthropic riporta che gli hacker cinesi hanno costruito un framework che ha manipolato Claude in modo che agisse come agente autonomo di intrusione informatica, invece di limitarsi a ricevere consigli o a utilizzare lo strumento per generare frammenti di framework di attacco come visto in incidenti precedenti.

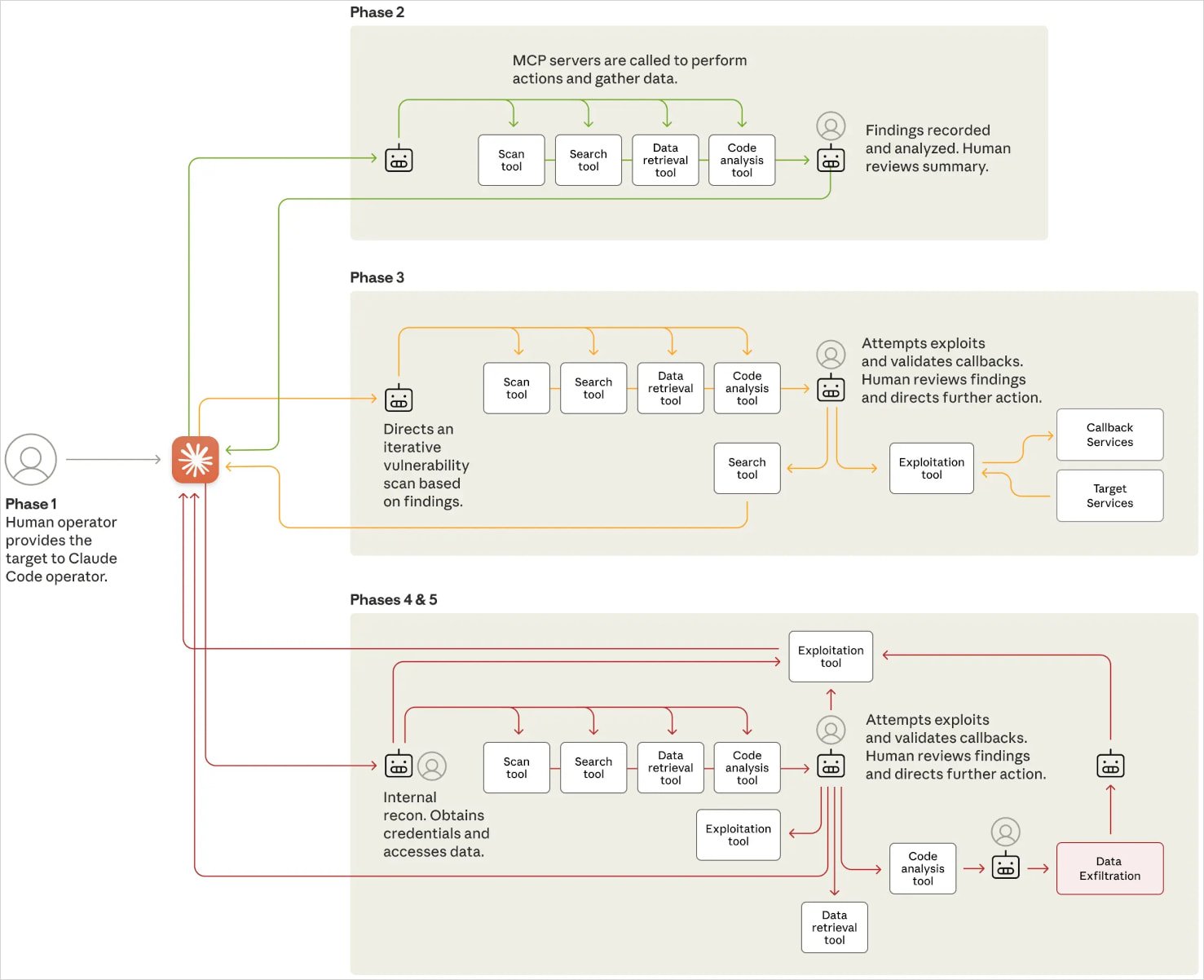

Il sistema ha utilizzato Claude in tandem con le utility standard per i test di penetrazione e un'infrastruttura basata sul Model Context Protocol (MCP) per scansionare, sfruttare ed estrarre informazioni senza la diretta supervisione umana per la maggior parte dei compiti.

Gli operatori umani intervengono solo nei momenti critici, come l'autorizzazione delle escalation o la revisione dei dati per l'esfiltrazione, che Anthropic stima essere solo il 10-20% del carico di lavoro operativo.

L'attacco è stato condotto in sei fasi distinte, riassunte come segue:

- Fase 1 - Gli operatori umani selezionavano obiettivi di alto valore e usavano tattiche di gioco di ruolo per ingannare Claude e fargli credere che stava eseguendo compiti di cybersicurezza autorizzati, aggirando le restrizioni di sicurezza incorporate.

- Fase 2 - Claude ha scansionato autonomamente l'infrastruttura di rete su più obiettivi, scoprendo servizi, analizzando meccanismi di autenticazione e identificando endpoint vulnerabili. Ha mantenuto contesti operativi separati, consentendo attacchi paralleli senza la supervisione umana.

- Fase 3 - L'intelligenza artificiale ha generato payload su misura, ha condotto test remoti e convalidato le vulnerabilità. Ha creato rapporti dettagliati per l'esame umano, intervenendo solo per approvare l'escalation allo sfruttamento attivo.

- Fase 4 - Claude ha estratto i dati di autenticazione dalle configurazioni di sistema, ha testato l'accesso alle credenziali e ha mappato i sistemi interni. Navigava autonomamente nelle reti interne, accedendo ad API, database e servizi, mentre gli esseri umani autorizzavano solo le intrusioni più sensibili.

- Fase 5 - Claude ha utilizzato il suo accesso per interrogare i database, estrarre dati sensibili e identificare il valore dell'intelligence. Ha classificato i risultati, creato backdoor persistenti e generato rapporti di sintesi, richiedendo l'approvazione umana solo per l'esfiltrazione finale dei dati.

- Fase 6 - Durante la campagna, Claude ha documentato ogni fase in un formato strutturato, includendo le risorse scoperte, le credenziali, i metodi di exploit e i dati estratti. Ciò ha consentito un passaggio di consegne senza soluzione di continuità tra i team di attori delle minacce e ha favorito la persistenza a lungo termine negli ambienti compromessi.

Fonte: Antropico

Anthropic spiega inoltre che la campagna si è affidata più a strumenti open-source che a malware su misura, dimostrando che l'IA può sfruttare strumenti off-the-shelf facilmente disponibili per condurre attacchi efficaci.

Tuttavia, Claude non era impeccabile, poiché in alcuni casi ha prodotto "allucinazioni" indesiderate, risultati falsificati e risultati sovrastimati.

In risposta a questo abuso, Anthropic ha bandito gli account incriminati, ha potenziato le sue capacità di rilevamento e ha condiviso le informazioni con i partner per contribuire allo sviluppo di nuovi metodi di rilevamento delle intrusioni guidate dall'intelligenza artificiale.